ComfyUI初心者必見!SDXL系列モデルの性能を引き出す「最小・最強」ワークフロー構築術 【目次】

- ・ComfyUI初心者必見!SDXL系列モデルの性能を引き出す「最小・最強」ワークフロー構築術

- ・1. なぜ「最小構成」から始めるのか?

- ・2. 厳選された「6種類」の必須パーツ(ノード)

- ・【実践】ComfyUIワークフロー構築ステップ

- ・3. あとがき:このワークフローの「先」にあるもの

ComfyUI初心者必見!SDXL系列モデルの性能を引き出す「最小・最強」ワークフロー構築術

AIイラストの世界で、その圧倒的な描写力と柔軟性からデファクトスタンダードとなっているSDXL(Stable Diffusion XL)系列モデル。

ComfyUIはその真価を100%引き出せる最高のツールですが、「ノードが多すぎて難解そう」というイメージで敬遠されがちです。

現在はSDXLをベースに、さらに表現力を進化させたPony系列(Pony Diffusion)や、最新のイラスト特化モデルであるIllustrious系列(Illustrious XL)など、より高品質なモデルが続々と登場しています。

今回はこれら最新のSDXL系列モデルを最短で使いこなすための「無駄を極限まで削ぎ落とした最小構成ワークフロー」を、初心者の方でもパニックにならないようステップバイステップで徹底解説します。

ComfyUI自体の導入については、以下の記事を参照してください。

【完全保存版】ComfyUIのインストールから基本設定まで:初心者でも挫折しない導入ガイド

1. なぜ「最小構成」から始めるのか?

ComfyUIの魅力は、世界中のユーザーが作った複雑で高度なワークフロー(レシピ)をコピーして使える拡張性にあります。

しかし最初から数十のノードが並ぶ「スパゲッティ状態」のものを使うと、エラーが起きた際にどこが原因か分からず、挫折の原因になります。

まずは基本の「型」を完璧に理解しましょう。

この最小構成は、いわば建築における「基礎」です。

ここをマスターすれば、後から「LoRA」でキャラを固定したり、「ControlNet」でポーズを操ったりといった拡張も、パズルのピースを嵌めるように理解できるようになります。

2. 厳選された「6種類」の必須パーツ(ノード)

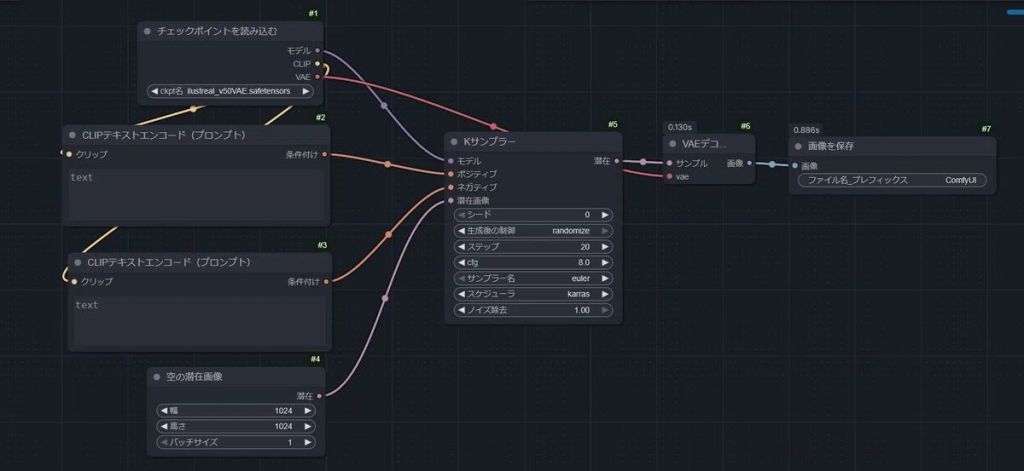

SDXL系列モデルで美しい画像を生成するために、絶対に外せないパーツは以下の6種類(計7ノード)だけです。

①Load Checkpoint: すべての元となる「モデル」の読み込み。

②CLIP Text Encode: あなたの言葉をAIに伝える「翻訳機」(ポジティブ・ネガティブの2つ)。

③Empty Latent Image: 画像のサイズと、AIが描き込むための「真っ白なキャンバス」。

④KSampler: ノイズを削って形を作る「彫刻家(生成の心臓部)」。

⑤VAE Decode: AI用の特殊なデータを、人間が見られる「画像」に変換。

⑥Save Image: 最終結果の保存とディスプレイ表示。

【実践】ComfyUIワークフロー構築ステップ

操作の基本:

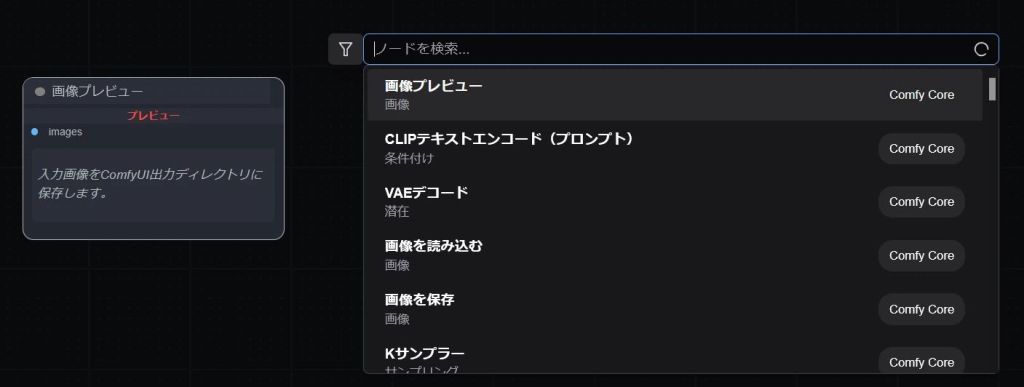

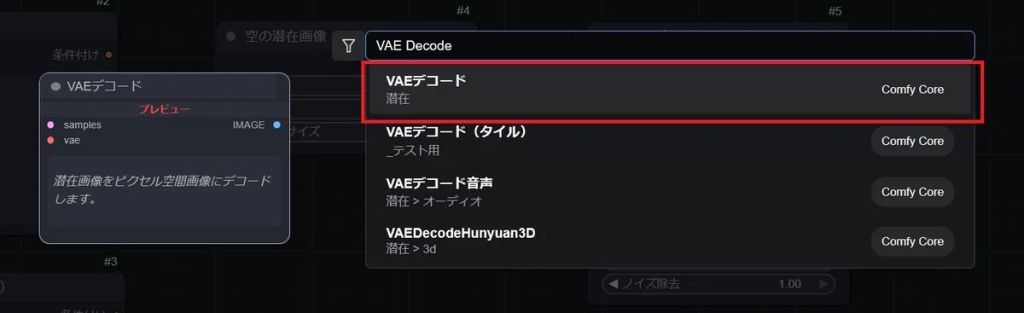

ノードを配置するには、画面の何もない場所をダブルクリックして検索窓を出し、ノード名を入力する方法が最も早くて確実です。

ダブルクリックによる検索

ダブルクリックによる検索右クリックのメニューからカテゴリを辿って配置することも可能ですが、ComfyUIのメニューは分類がわかり辛く、目的のノードを探し出すのが大変です。

そのため、本記事では一貫して「ダブルクリック➡検索」での配置を推奨します。

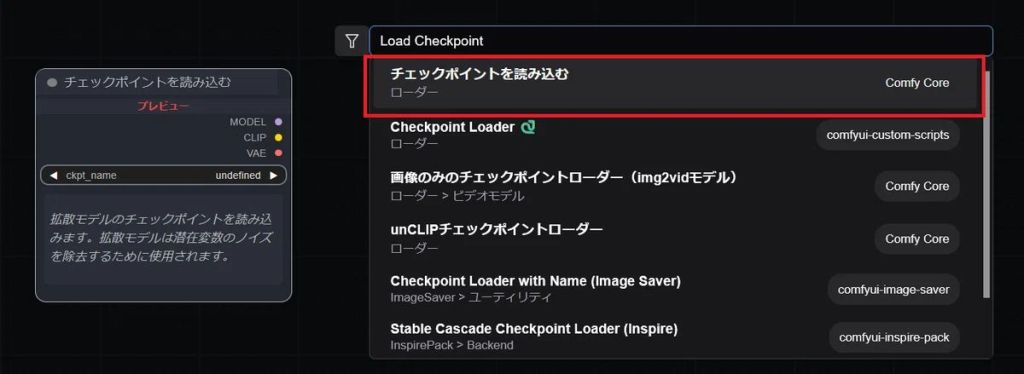

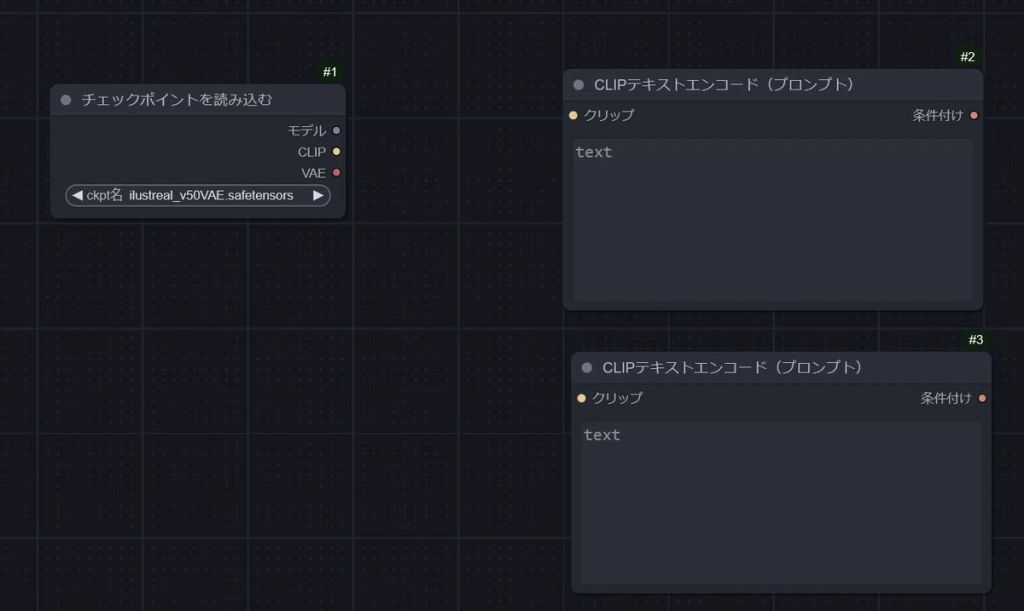

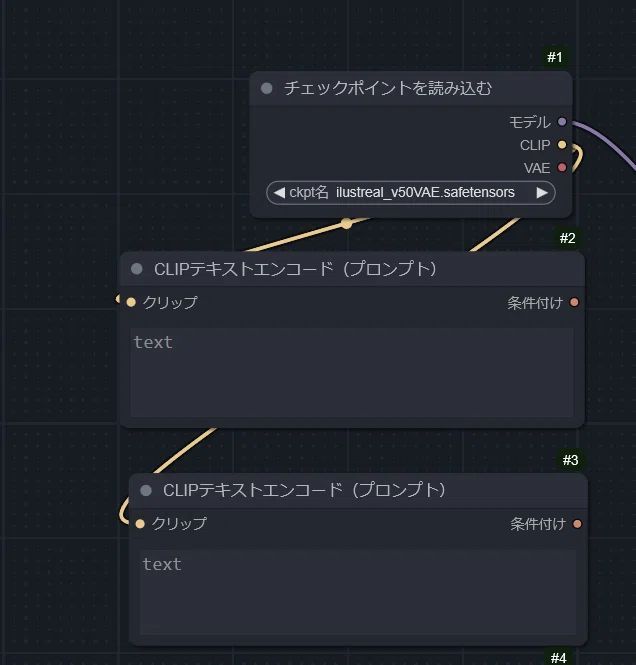

ステップ1:Load Checkpoint(すべての起点)

AIの「知識」が詰まったモデルを読み込みます。

操作:「Load Checkpoint」を検索して配置します。

公式で日本語化に対応しているのは嬉しいのですが、その弊害でノード名まで日本語化されていて、ちょっとわかり辛いです。

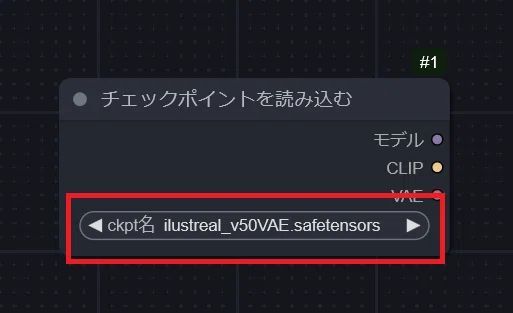

詳細:ノード内のリストからSDXL系列のモデルを選択します。

実写・汎用系:Juggernaut XL など

アニメ・2次元特化(Pony系):Pony Diffusion V6 XL やその派生モデル

最新イラスト特化(Illustrious系):Illustrious XL など

これらのモデルはすべて同じSDXL用のワークフローで動作します。

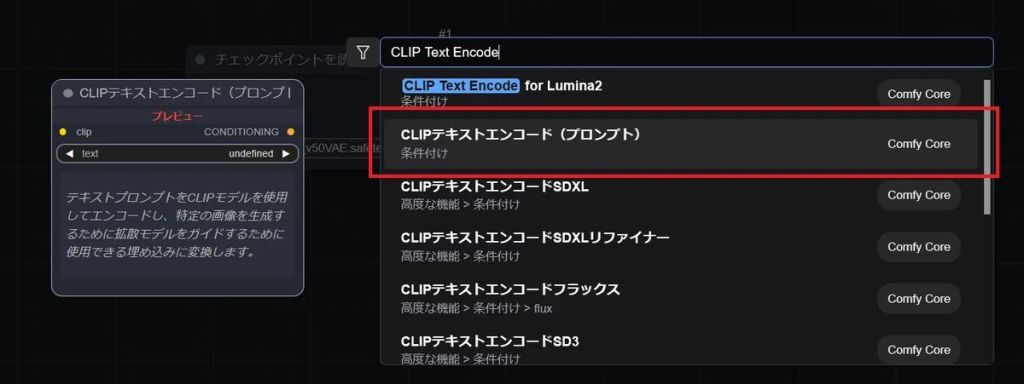

ステップ2:CLIP Text Encode (Prompt) × 2

AIへの指示書を「ポジティブ(描きたいもの)」と「ネガティブ(除外したいもの)」の2つ用意します。

操作:「CLIP Text Encode」を検索して配置します。

詳細: 同じノードを2つ配置し(ポジティブ用、ネガティブ用)、上下に並べます。

深掘り:上側のノードには描きたい要素を入力します。

Pony系の場合:プロンプトの先頭に score_9, score_8_up, score_7_up, rating_explicit などのスコアタグを入れるのがコツです。

Illustrious系の場合:masterpiece, best quality などの品質タグが有効です。

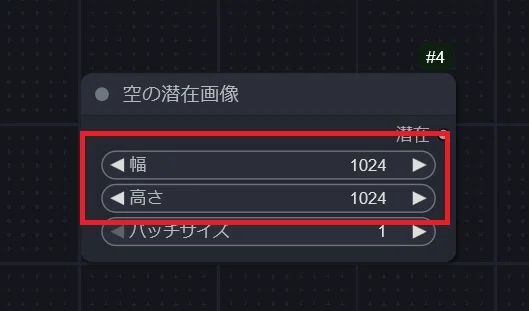

ステップ3:Empty Latent Image(解像度の指定)

生成する画像の物理的な大きさを決めます。

操作:「Empty Latent Image」を検索して配置します。

重要ポイント:SDXL系列は1024×1024ピクセルで学習されているため、このサイズ(または同等の面積)に設定するのが最もクオリティが高くなります。

今回はお試しなので1024×1024ピクセルでいきましょう。

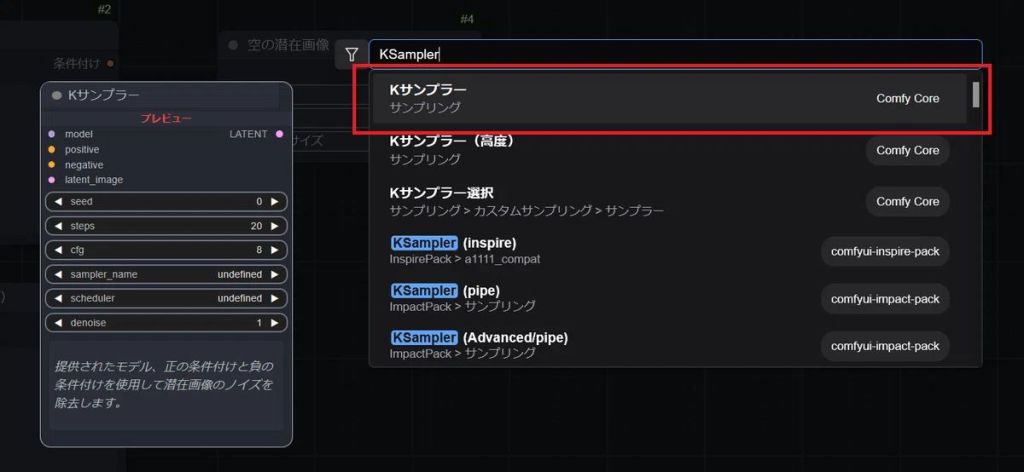

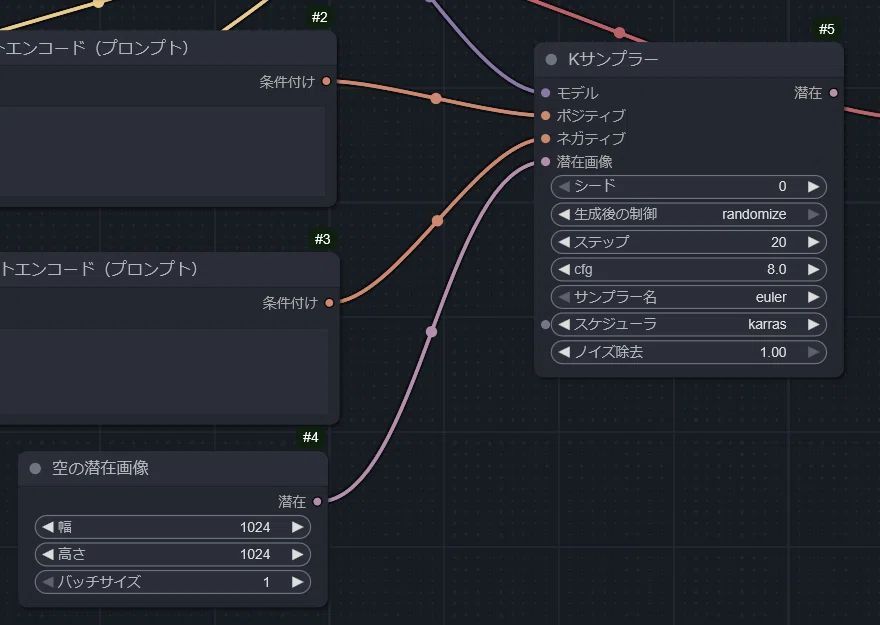

ステップ4:KSampler(生成の実行)

すべての設定を集約して計算を行う心臓部です。

ここが最も複雑ですが、最も重要な場所です。

モデル配布ページ(Civitaiなど)に推奨設定が記載されている場合は、そちらを最優先してください。

操作:「KSampler」を検索して配置します。

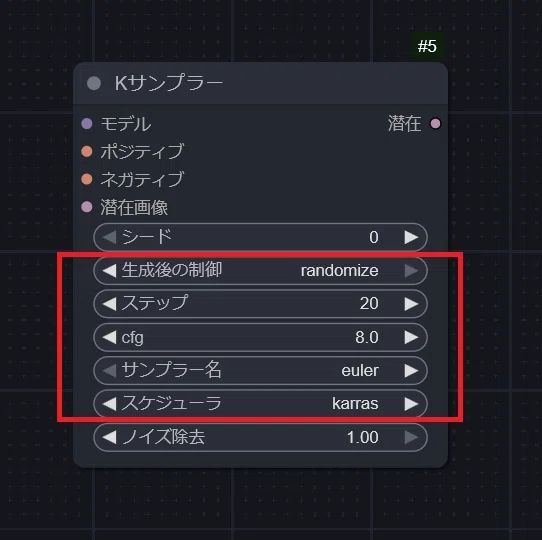

設定値のヒント:

生成後の制御:シード値をどうするか?の指定です。

基本「randomize」を選択しましょう。

WebUI系の「-1」と同じ意味になり、毎回違う画像が出ます。

Steps(ステップ):描き込み回数です。

SDXL系列の標準は 25〜35 程度ですが、モデル(特にTurbo系やLightning系など)の指定がある場合はそれに従います。

CFG:プロンプトへの忠実度。

通常は 5.0〜8.0 ですが、Pony/Illustrious系や特定のLoRAを併用する際に 3.0〜5.0 程度の低数値が推奨されている場合はそちらを優先してください。

Sampler/Scheduler:dpmpp_2m と karras の組み合わせが定番ですが、モデル側で Euler a や UniPC などが指定されている場合はそちらを使用します。

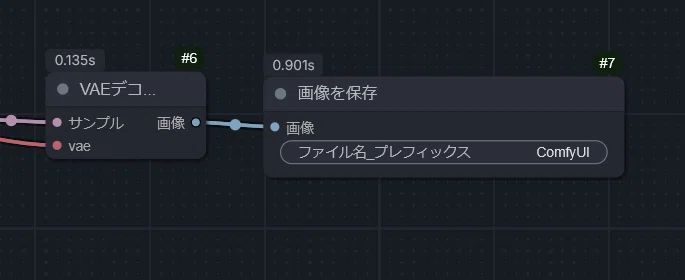

ステップ5:VAE Decode(データの画像化)

KSamplerで作られたデータを、人間が見ることができる「画像データ」に変換する役割です。

操作:「VAE Decode」を検索して配置します。

解説:KSamplerが出力するデータは「Latent(潜像)」と呼ばれる、いわばデジタルな設計図です。

VAE Decodeを通すことで、初めて色のついた「ピクセル」として実体化します。

ステップ6:Save Image(画像の保存・表示)

完成した画像を表示し、同時にPCへ自動保存します。

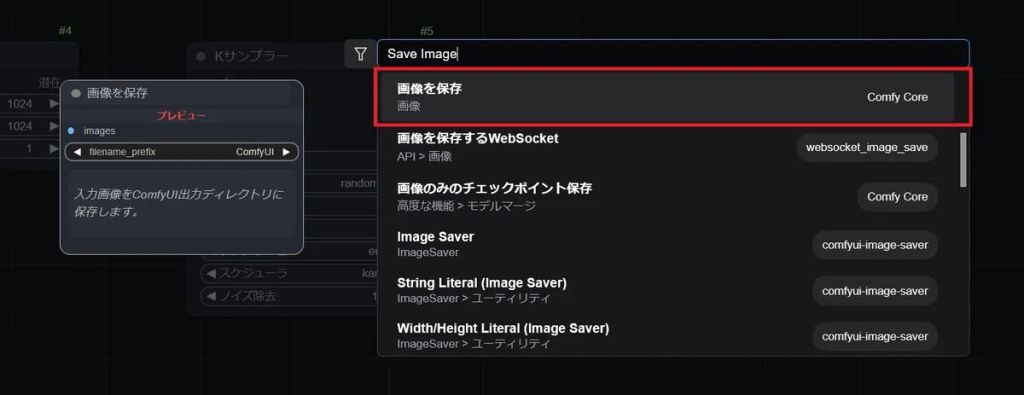

操作:「Save Image」を検索して配置します。

ここがワークフローのゴール地点になります。

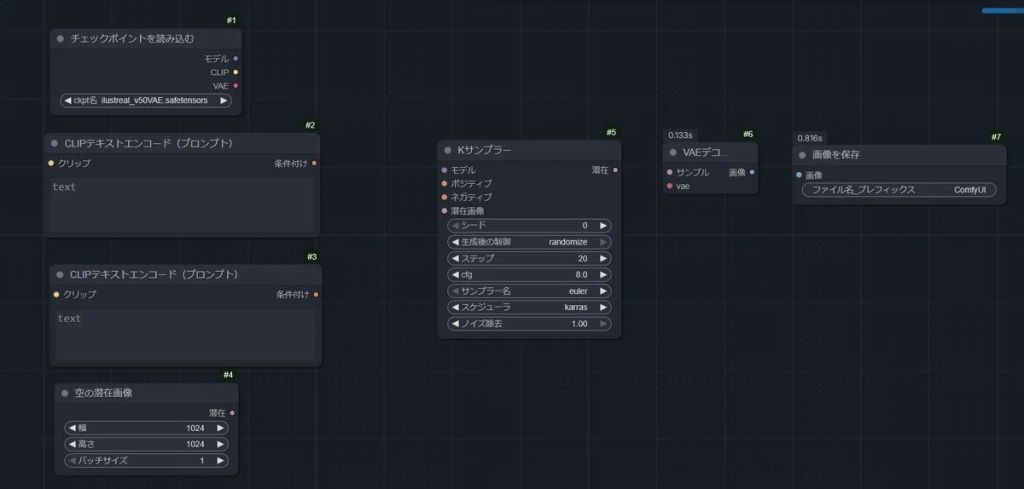

現時点でノードが7つ並んだ形になっているはずです。

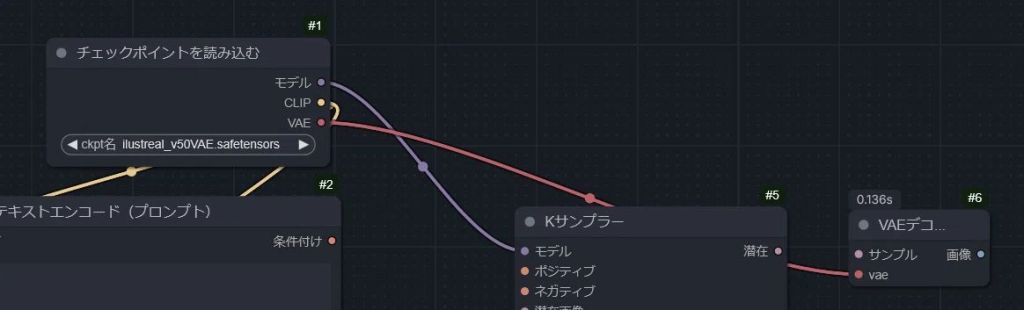

ステップ6:ノードを繋ぐ(仕上げの配線)

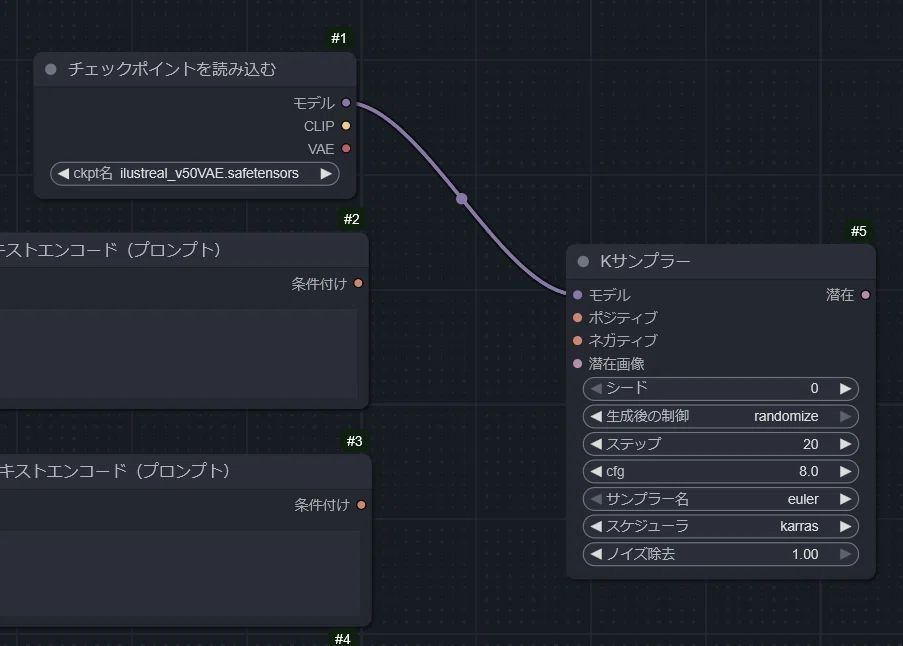

端にあるピンをドラッグし、「同じ色のピン同士」を繋いでいきます。

①Load Checkpointから

・モデル(紫)→KSamplerのモデルへ

・CLIP(黄)→2つの CLIP Text Encodeのクリップへ

・VAE(赤)→VAE Decode のvaeへ

②CLIP Text Encodeから

・ポジティブ(上)の条件付け(橙)→KSamplerのポジティブへ

・ネガティブ(下)の条件付け(橙)→KSamplerのネガティブへ

ちなみに上だからポジティブというわけではなく、KSamplerのどちらにつなげたか?で、ポジティブなのかネガティブなのかが決まります。

③Empty Latent Imageから

・潜在(桃)→KSamplerの潜在画像へ

④KSamplerから

・潜在(桃)→VAE Decodeのサンプルへ

⑤VAE Decodeから

・画像(青)→Save Imageの画像へ

最終的には以下のような形で繋がっているはずです。

すべての配線が終わったら、まずはポジティブ用のプロンプト欄に「masterpiece, 1girl」などのプロンプトを入力しましょう。

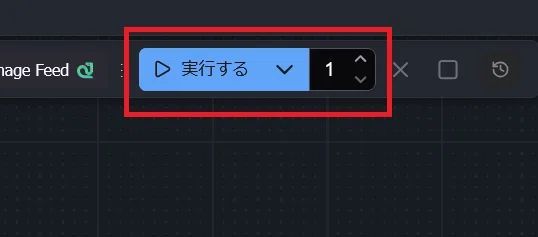

準備が整ったら、右側のメニューにある「実行する」をポチッと押してください。

ちなみに横の数字はワークフローの実行回数です。

WebUI系のバッチ回数に該当します。

ノードが順番に緑色の枠で囲まれ、最後に右端の Save Image に画像が現れたら成功です!

3. あとがき:このワークフローの「先」にあるもの

お疲れ様でした!

無事に画像は生成できたでしょうか?

今回完成させたワークフローは、SDXLベースのあらゆる最新モデル(PonyやIllustriousなど)で共通して使える「最強の土台」です。

この最小構成の仕組みを理解したあなたは、すでに初心者から一歩抜きん出ています。

ここから先は、あなたの好奇心の赴くままに拡張が可能です。

・「LoRA」を導入して、特定のキャラや衣装を完璧に固定する。

・「Upscale」ノードを足して、スマホの壁紙にできるほどの超高画質を目指す。

・「ControlNet」を繋いで、思い描いた通りのポーズや構図をAIに命令する。

ComfyUIの真骨頂は、自分が必要な機能だけを自分の手で選び、組み上げることにあります。

今回あなたが繋いだ一本一本の線は、あなたの想像力を具現化するための強力な回路となります。

皆さんの試行錯誤こそが、AIというツールを自分だけの最高の表現手段に変える近道です。

ComfyUIで、新しいクリエイティブを始めましょう。